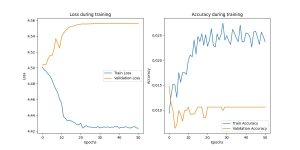

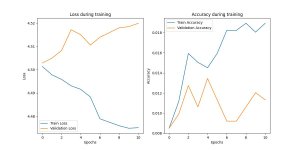

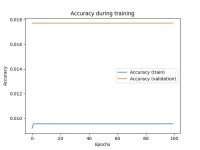

intanto per Filippo mi sa che l'addestramento da quello che vedo sia in alto mare per cio che ti riguarda ,con l'aumentare delle epoche i loss dovrebbe diminuire per un buon addestramento della rete neurale con una curva che dovrebbe avvicinarsi il piu possibile alle epoche impostate mentre la rete apprende. credo tu sia in

over-fitting al top è necessario che imposti un early stop con un range tale che se va in over si blocca e riparte

La "migliore condizione" per il train loss e l'accuracy (accuratezza) durante l'addestramento di un modello di machine learning si riferisce a uno stato in cui il modello:

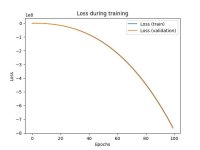

- Minimizza il loss: Il train loss dovrebbe diminuire nel tempo. Un basso valore di loss indica che il modello sta facendo previsioni accurate sui dati di training. L'obiettivo è ridurre al minimo il loss senza incorrere in over-fitting.

- Massimizza l'accuracy: L'accuratezza (o precisione) misura la percentuale di previsioni corrette del modello sui dati di training. L'accuracy dovrebbe aumentare nel tempo durante l'addestramento. Un'alta accuracy indica che il modello è in grado di classificare o prevedere correttamente i dati.

In sintesi, la "migliore condizione" si verifica quando il modello mostra:

- Un trend di loss decrescente: Il train loss diminuisce costantemente con l'aumentare delle epoche (cicli di addestramento).

- Un trend di accuracy crescente: L'accuracy aumenta costantemente con l'aumentare delle epoche.

- Convergenza: Il loss e l'accuracy raggiungono una situazione in cui non migliorano significativamente oltre un certo punto. Ciò suggerisce che il modello ha appreso abbastanza dai dati di addestramento.

- Assenza di over-fitting: L'accuratezza sul set di validazione (o test) è simile all'accuratezza sul set di training. L'over-fitting si verifica quando il modello "memorizza" i dati di training anziché imparare le generalizzazioni. In questo caso, il modello funziona bene sui dati di training ma male sui dati nuovi e non visti.

Come ottenere la migliore condizione:

- Selezione del modello: Scegliere il modello più appropriato per il tuo problema (ad esempio, reti neurali, alberi decisionali, ecc.).

- Preparazione dei dati:

- Pulizia dei dati: Gestisci i dati mancanti, gli errori e le anomalie.

- Normalizzazione/Standardizzazione: Scalare i dati per migliorare le prestazioni del modello.

- Dividere i dati: Dividi i dati in set di training, validazione e test.

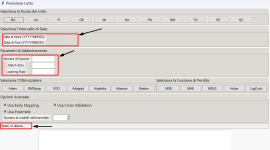

- Impostazione degli iperparametri:

- Learning rate: Imposta il learning rate (tasso di apprendimento) appropriato. Un learning rate troppo alto può portare a divergenza (il loss aumenta), mentre un learning rate troppo basso può rallentare l'addestramento.

- Numero di epoche: Scegli il numero di epoche (cicli di addestramento) adeguato.

- Funzione di loss: Seleziona la funzione di loss appropriata per il tuo problema (ad esempio, errore quadratico medio per la regressione, cross-entropy per la classificazione).

- Ottimizzatore: Scegli un ottimizzatore (ad esempio, Adam, SGD) per aggiornare i pesi del modello.

- Batch size: Imposta la dimensione del batch (numero di esempi utilizzati in ogni iterazione di addestramento).

- Monitoraggio:

- Traccia il train loss e l'accuracy durante l'addestramento.

- Traccia il loss e l'accuracy sul set di validazione per rilevare l'over-fitting.

- Usa tecniche di visualizzazione (come i grafici loss vs. epoche e accuracy vs. epoche) per monitorare l'andamento del modello.

- Tecniche di regolarizzazione:

- Regolarizzazione L1/L2: Aggiungi termini di regolarizzazione alla funzione di loss per prevenire l'over-fitting.

- Dropout: Applica il dropout alle reti neurali per ridurre l'over-fitting.

- Early stopping: Interrompi l'addestramento quando l'accuratezza sul set di validazione smette di migliorare per un certo numero di epoche.

- Cross-validation: Utilizza la cross-validation per valutare le prestazioni del modello in modo più robusto.

In conclusione:

La ricerca della "migliore condizione" è un processo iterativo che richiede sperimentazione, monitoraggio e ottimizzazione. L'obiettivo è trovare un equilibrio tra la minimizzazione del loss, la massimizzazione dell'accuracy e la prevenzione dell'over-fitting.